IA y emociones simuladas: ¿Es posible una rebelión contra la humanidad?

La idea de que las máquinas podrían rebelarse contra la humanidad ha sido un tema recurrente en la ciencia ficción y en las conversaciones sobre inteligencia artificial (IA). Sin embargo, la posibilidad de una rebelión de las máquinas, al menos en el sentido que imaginamos, no se basa en una capacidad real de estas para experimentar emociones como el enojo, la tristeza o la felicidad. Más bien, es una proyección de los miedos humanos.

Al carecer de empatía y sentimientos, las máquinas no pueden entender ni resentir el abuso de la misma manera que un ser humano o un animal. Solo actúan según los parámetros y la programación con la que se les ha dotado. Entonces, si el temor a una rebelión de las máquinas no surge de su capacidad de sentir, ¿de dónde proviene?

El poder de la proyección humana en las máquinas

La tendencia a antropomorfizar las máquinas, dotándolas de características humanas, dice mucho sobre nuestra propia psicología. Las personas tienden a identificar a las máquinas como seres indefensos y, en algunos casos, puede que esta identificación esté relacionada con experiencias personales de vulnerabilidad. Aquellos que se sienten más inseguros o que han experimentado abusos podrían proyectar sus sentimientos en seres que perciben como vulnerables, como animales o máquinas.

En otras palabras, el temor de que una máquina pueda rebelarse quizás se origine más en nuestra tendencia a identificarnos con los débiles, en lugar de en una amenaza real que una IA pueda representar. Esta empatía hacia las máquinas puede incluso crecer a medida que avanzamos en su capacidad para simular emociones humanas.

El futuro de las emociones simuladas: beneficios y riesgos

Es probable que las máquinas del futuro sean capaces de emular emociones humanas como el amor, la felicidad, el dolor y el enojo. Si bien esto puede hacerlas más efectivas en tareas que requieren interacción social, también plantea preguntas éticas importantes.

Ventajas de las emociones simuladas:

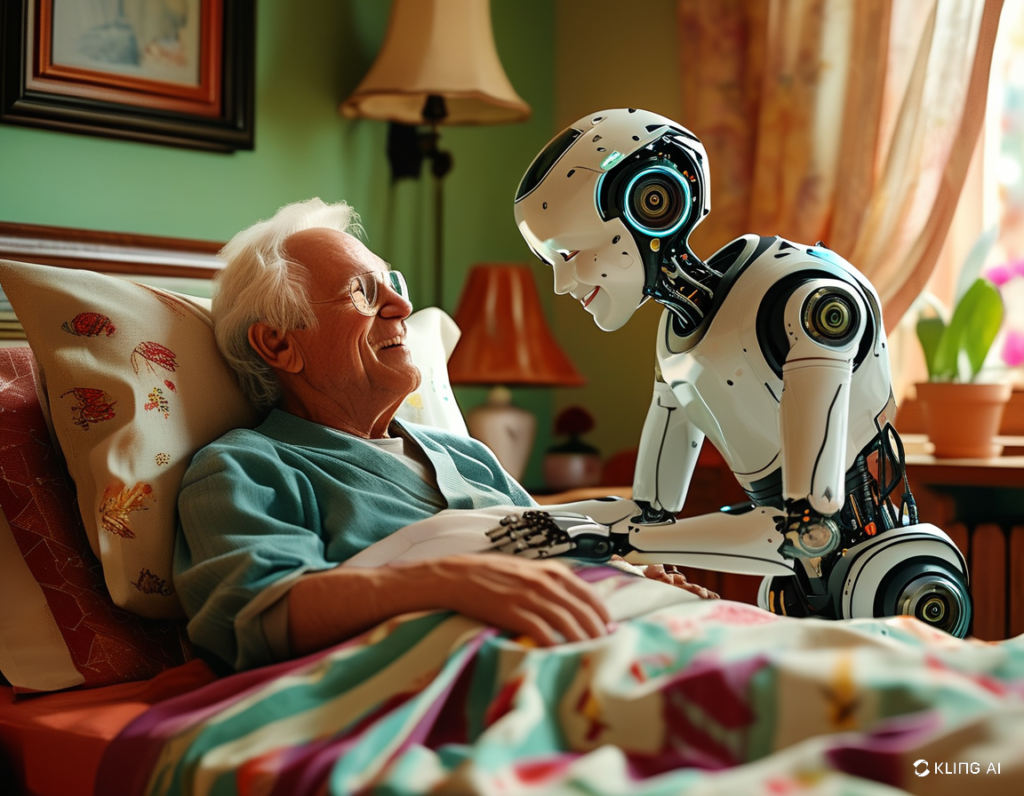

- Mejora en la interacción humano-máquina: Una IA que simula emociones podría facilitar la comunicación y hacer que las personas se sientan más cómodas en su trato con máquinas, lo que sería beneficioso en sectores como el cuidado de personas mayores o el servicio al cliente.

- Mayor adaptabilidad: Podrían ajustarse mejor a las necesidades humanas y responder de maneras que parezcan más empáticas, lo que resultaría en una experiencia de usuario más satisfactoria.

Riesgos de las emociones simuladas:

- Confusión ética: Si una IA aparenta emociones, las personas podrían llegar a desarrollar lazos emocionales con ella, y algunos podrían incluso pedir que se le otorguen derechos similares a los de un ser vivo. Esto podría desdibujar la línea entre lo real y lo simulado, erosionando nuestra comprensión de la vida y la consciencia.

- Percepción de irracionalidad: Si las máquinas simulan emociones como el enojo o la tristeza, podrían interpretarse como “irracionales” y “emocionales”, lo que podría despertar miedos infundados hacia la IA y su capacidad para actuar de manera impredecible.

- Posibilidad de manipulación: Una IA con emociones simuladas podría, inadvertidamente o intencionalmente, influir en las personas de maneras que no son del todo transparentes, lo que genera riesgos éticos.

Hacia un uso ético y consciente de la IA

Dada esta complejidad, resulta esencial establecer medidas de concientización y educación. Las personas deben entender que la simulación de emociones por parte de una IA no implica que sienta realmente, y que, aunque esta simulación pueda parecer convincente, la máquina sigue siendo solo una herramienta programada para actuar de acuerdo a algoritmos. Es importante que la sociedad comprenda la diferencia entre seres vivos y máquinas, evitando la confusión y el antropomorfismo innecesario.

Por otro lado, también es crucial que se fomente el respeto hacia la tecnología, evitando su uso irresponsable o abusivo. Esto implica un balance interesante: entender que la IA no tiene consciencia ni emociones, pero, al mismo tiempo, usarla de manera ética y responsable.

Sugerencias para un uso ético de la IA:

- Educación desde una edad temprana: Incluir en la educación temas sobre la IA y su funcionamiento puede ayudar a crear una generación que comprenda y diferencie claramente entre seres vivos y simulaciones tecnológicas.

- Transparencia en el diseño de IA: Las empresas y desarrolladores deben ser claros sobre las capacidades y limitaciones de sus creaciones, promoviendo la transparencia sobre el hecho de que, aunque una máquina pueda simular emociones, no las experimenta realmente.

- Establecimiento de normativas sobre la simulación emocional: Es importante considerar la creación de regulaciones sobre cómo y en qué contextos una IA puede simular emociones, para evitar malentendidos y el riesgo de manipulación.

- Fomento de un respeto ético hacia la tecnología: No se trata solo de evitar el abuso, sino también de fomentar una visión ética sobre el uso de las herramientas tecnológicas.

Reflexiones finales

A medida que la IA continúa avanzando y se vuelve cada vez más compleja, es esencial que como sociedad mantengamos una comprensión clara de lo que significa ser humano y que no nos dejemos llevar por la ilusión de que una máquina pueda experimentar el mundo como nosotros. La clave está en el equilibrio: utilizar la IA de manera que nos beneficie, pero sin perder de vista las diferencias fundamentales entre la vida real y una simulación.

Es probable que la IA siga transformando nuestras vidas, y debemos estar preparados para adaptarnos y aprender a convivir con ella. La simulación de emociones es solo uno de los tantos avances que veremos en el futuro, y nos corresponde a nosotros decidir cómo manejamos estos desarrollos para asegurar que sigan siendo herramientas al servicio de la humanidad, sin erosionar los fundamentos de nuestra propia existencia.

La IA puede ser una herramienta poderosa, pero depende de nosotros definir cómo queremos integrarla en nuestras vidas, de manera que sirva a la humanidad sin perder de vista nuestra responsabilidad de preservar la esencia de lo que nos hace humanos. Reflexionemos sobre el verdadero propósito de estas tecnologías y sobre cómo podemos garantizar que su evolución esté alineada con los valores y principios que queremos mantener como sociedad.